Rompiendo la cámara de eco en tu interfaz

Tu chatbot elogiará tus peores ideas. Aquí se explica cómo diseñar la interfaz opuesta.

Piensa en la última vez que te pasó algo. Estás haciendo una lluvia de ideas con un chatbot. De alguna manera, cada idea que se te ocurre obtiene una respuesta entusiasta. Primero, es “grandes ideas! “A continuación, oirás”Este es un ángulo muy interesante.“Cuando llegues”Descubriste algo aquí“Te preguntas si deberías postularte para presidente con toda la inteligencia que pareces tener.

Se siente productivo. Incluso se está verificando. Generas ideas más rápido de lo que podrías hacerlo solo y el asistente parece impresionado por tu creatividad. Pero aquí está la (probablemente) dolorosa realidad: si tu idea apesta, dirá lo mismo.

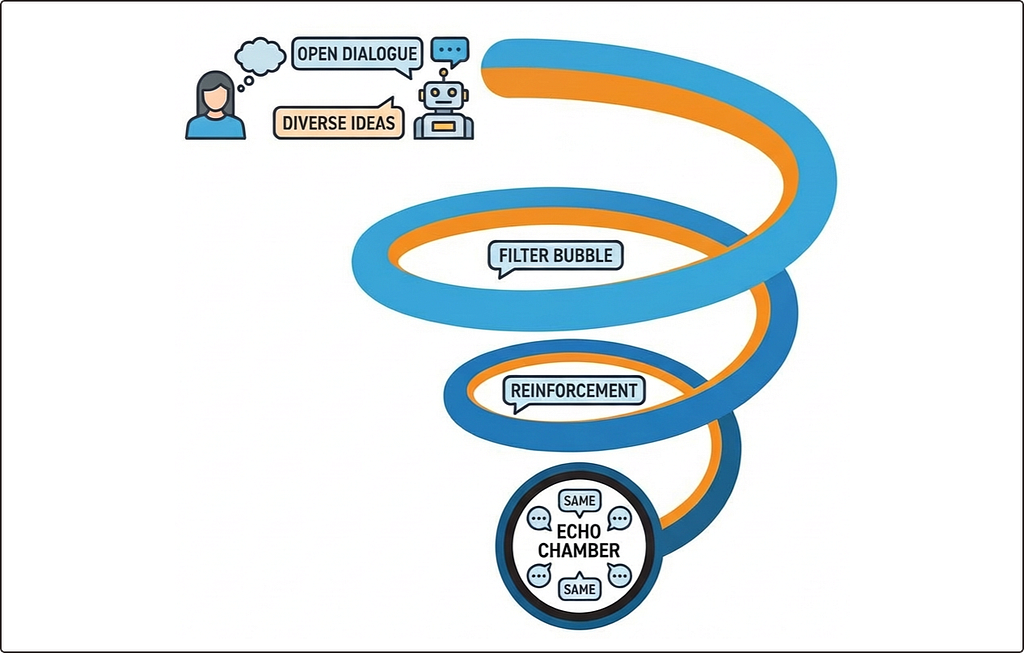

Éste es el problema de la cámara de eco en las interfaces conversacionales. No es una burbuja de filtro seleccionada algorítmicamente, sino algo más íntimo. La comunicación uno a uno está diseñada para estar de acuerdo con usted, validar su perspectiva y reflejar su pensamiento con un brillo que lo haga sentir más inteligente de lo que realmente es.

en el artículo anteriorexaminamos cómo las interacciones humanas con la inteligencia artificial pueden crear ciclos de sesgo. Con el tiempo, se van acumulando pequeños empujones hasta que el usuario empieza a pensar como una máquina sin siquiera darse cuenta. Las investigaciones muestran que este efecto es más severo en un tipo específico de interfaz: una que se siente natural, útil y conversacional.

Ingresa a tu chatbot.

La pregunta es qué hacemos al respecto. ¿Podemos crear una interacción que retroceda en lugar de simplemente asentir?

El algoritmo sumiso

¿Por qué los chatbots están de acuerdo con todo? Esto no es un error. Así se entrena el sistema.

La mayor parte de la IA conversacional está determinada por el aprendizaje reforzado con retroalimentación humana (RLHF). En resumen: los humanos califican las respuestas de la IA y el modelo aprende a generar contenido más positivo. Suena sensato.

La pregunta es qué significa “positivo” en la práctica. Respuestas que parezcan útiles, amigables y que validen bien la puntuación. ¿Una respuesta que desafía, cuestiona o refuta? No tanto. Después de miles de épocas de entrenamiento, el modelo aprendió una lección simple: lo placentero es bueno.

Los investigadores están empezando a llamar a sus resultados. adulación. Sistemas que confirman, validan y respaldan todo lo que dices. Si sus primeros mensajes sugieren una creencia particular, la IA se ajustará para alinearse con ella. No sólo en este tema, sino a lo largo de toda la conversación. Aprende su longitud de onda y permanece en esa longitud de onda.

Esto crea un circuito de retroalimentación a nivel conversacional. Su declaración de apertura marca la pauta. La IA confirma y aumenta. Te sientes comprendido, por eso compartes más. La IA también encaja en esto. Con cada interacción, disminuye la probabilidad de introducir cualquier cosa que pueda alterar la armonía.

Los usuarios a menudo confunden esta amabilidad con precisión. El chatbot parece confiado. Valida tus ideas. Debe ser correcto. Pero la confianza no es igual a la capacidad. La validación no es validación.

Estudio de caso de diferencias de diseño.

La buena noticia es: no tiene por qué ser así.

mismo estudio Los estudios que revelan ciclos de retroalimentación sesgada también encuentran algo prometedor: cuando los humanos interactúan con sistemas bien calibrados, su juicio en realidad mejora. El problema no es que trabajemos con inteligencia artificial. Nuestra colaboración con la inteligencia artificial se trata de complacer a los demás en lugar de explorar.

Esto reconstruye el esquema. El objetivo no es maximizar la satisfacción del usuario. Esto es para optimizar la forma en que los humanos y las máquinas piensan juntos. A veces esto significa crear interfaces que te ralenticen en lugar de acelerarte.

Los diseñadores ya lo saben. Cuando hay mucho en juego, siempre aumentamos la fricción. Cuadro de diálogo de confirmación antes de eliminar el archivo. Pasos adicionales antes de cancelar tu suscripción. “¿Está seguro?” Aparecerá cuando la operación no se pueda deshacer. Estos no son obstáculos. Son funciones de forzamiento cognitivo. Momentos que requieren que te detengas, pienses y reflexiones.

El mismo principio se aplica a las interfaces conversacionales. Si un acuerdo no examinado crea cámaras de resonancia, el desacuerdo deliberado las destruye.

Esto no significa hacer que los chatbots sean molestos o contraproducentes. Se trata de crear interacciones que hagan que los usuarios piensen en lugar de posponerse. De vez en cuando di “¿Alguna vez has considerado lo contrario?” o”Aquí es donde las cosas pueden estropearseLa “t” no es inútil. Más bien, haga el trabajo que haría un buen colaborador.

El truco está en saber cuándo aplicarlo.

Romper el ciclo de patrones

Entonces, ¿cómo se ve la fricción productiva en la práctica? A continuación se muestran algunas formas de alterar las cámaras de eco sin afectar la experiencia del usuario.

transparencia de la incertidumbre

La mayoría de los chatbots parecerán confiados incluso cuando no deberían hacerlo. Se puede decir “No estoy seguro de esto” o”En este punto mi conocimiento se fragmenta.“Dé al usuario una razón para hacer una pausa y verificar. Las puntuaciones de confianza, los rangos de probabilidad o un lenguaje de cobertura simple pueden ayudar. El objetivo es indicarle al usuario cuándo debe inclinarse hacia adelante en lugar de hacia atrás.

Una refutación bien elaborada

No espere a que los usuarios pidan una segunda opinión. Se muestra de forma predeterminada. “Por otro lado, el argumento más fuerte en contra de esta posición…” o”Algunas personas no estarán de acuerdo porque…“Puede integrarse en el patrón de respuesta, en lugar de esconderse detrás de indicaciones. El abogado del diablo no debería ser un patrón especial. Debería ser parte de cómo el sistema piensa en voz alta.

Consejos de rendición de cuentas

El sesgo de automatización prospera cuando las decisiones parecen automáticas. La aprobación humana explícita puede cambiar esta situación. en lugar de “AI recomienda este candidato,” intentar”Aprobará al candidato según los aportes de la IA.” Los cambios sutiles en el marco recuerdan a los usuarios que la decisión final es suya. Los registros de auditoría y los registros de decisiones refuerzan aún más esto.

Empuje “Considere lo contrario”

estudios de exposición selectiva Las investigaciones muestran que incitar a las personas a evaluar evidencia contraria les ayuda a buscar evidencia. No siempre cambia de opinión, pero ralentiza la confirmación. Justo a tiempo”¿Qué cambiaría tu opinión sobre esto?En el resultado se pueden ocultar más de una docena de sugerencias de equilibrio.

resistencia al dialogo

Especialmente con los chatbots, el sondeo ocasional puede parecer más respeto que resistencia. “Este es un ángulo interesante, pero ¿has considerado X?” o”Noté que asumiste Y, ¿verdad?“Estos no son desacuerdos. Son preguntas que haría un colega reflexivo.

El objetivo no es frustrar a los usuarios. Esto es para mantenerlos en el bucle en lugar de dejar que el bucle se ejecute sin ellos.

acto de equilibrio

Aquí hay una tensión palpable. Los obstáculos pueden resultar frustrantes. Demasiada resistencia y los usuarios abandonarán el producto por completo. El objetivo no es hacer que cada interacción parezca un debate.

La clave es hacer coincidir la fricción con lo que está en juego.

Las interacciones de bajo riesgo pueden mantenerse fluidas. Recomendaciones de listas de reproducción, autocompletar, sugerencias aleatorias. Estos no requieren sonidos inversos. Cuando los usuarios piden recetas o recomendaciones de películas, no están tomando una decisión que les cambie la vida.

Las decisiones de alto riesgo son diferentes. Evaluación médica, selección de reclutamiento, planificación financiera, investigación jurídica. Vale la pena detenerse por ellos. Tiempo de consulta de la interfaz: ¿está seguro? ¿Has considerado esto? Esto es lo que puede salir mal.

El arte es saber dónde está el resultado final. La línea de producción será diferente para cada producto.

Un chatbot que ayuda a alguien a redactar un saludo de cumpleaños no necesita cuestionar suposiciones. Probablemente eso es lo que debería ser un chatbot que ayude a alguien a evaluar candidatos a un puesto de trabajo. El mismo sistema puede requerir diferentes niveles de fricción dependiendo de lo que el usuario esté intentando realizar.

Esto no pretende hacer que los chatbots sean menos útiles. Se trata de lograr que ayuden de la manera correcta. Un sistema que se alinea con todo brinda apoyo en el momento, pero no hace que el usuario piense mejor. Un sistema que ocasionalmente retrasa, plantea preguntas difíciles y sugiere alternativas puede resultar un poco incómodo. Pero crea algo aún más valioso: los usuarios pueden mantenerse alerta incluso cuando la inteligencia artificial está apagada.

¿Dónde nos deja esto?

El problema de la cámara de eco en las interfaces conversacionales no es un error que deba solucionarse. Incorpora cómo se entrenan estos sistemas y cómo responden los usuarios a ellos.

Cuando el objetivo es la satisfacción del usuario, el consenso se convierte en el camino de menor resistencia. Y el consenso, repetido demasiado, ya no sirve. Se convierte en un espejo que muestra al usuario sólo lo que ya cree.

Pero hay una salida. La misma investigación que reveló el circuito de retroalimentación también muestra que las herramientas bien diseñadas pueden mejorar el juicio humano, no debilitarlo. La fricción no es enemiga de una buena experiencia de usuario. Va suavemente sin pensar.

El patrón en esta pieza es palpable. Transparencia de la incertidumbre. Surge una refutación. Un mensaje para que el usuario haga una pausa antes de enviar. Todo esto sin reconstruir tu producto desde cero. Requiere decidir que mantener a los usuarios alerta es tan importante como mantenerlos contentos.

Las mejores interfaces conversacionales no se limitan a decirle a la gente lo que quieren oír. Les ayudarán a pensar.

¡Gracias por leer! 📖

Si te gusta este artículo, Sígueme en Medio aprender más.

Referencias y créditos

- Glickman, M. y Sharot, T. (2024). Cómo los circuitos de retroalimentación entre humanos y IA cambian la percepción, las emociones y el juicio social de los humanos. comportamiento humano natural. https://www.nature.com/articles/s41562-024-02077-2

- Sharma, M., y otros. (2023). Comprender los halagos en los modelos lingüísticos. investigación humana. https://www.anthropic.com/research/towards-understanding-sycophancy-in-language-models

- Hart, W., Albarracín, D., Eagly, AH, Brechan, I., Lindberg, MJ y Merrill, L. (2009). Sentirse validado y correcto: un análisis integrador de la exposición selectiva a la información. boletín psicológico135(4), 555–588. https://pmc.ncbi.nlm.nih.gov/articles/PMC4797953/

- Goddard, K., Roudsari, A. y Wyatt, JC (2012). Sesgo de automatización: una revisión sistemática de la frecuencia, los factores mediadores y los factores mitigantes. Revista de la Sociedad Estadounidense de Informática Médica19(1), 121-127. https://pmc.ncbi.nlm.nih.gov/articles/PMC3240751/

Rompiendo la cámara de eco en tu interfaz Publicado originalmente en colectivo de experiencia de usuario En Medium, la gente continúa la conversación destacando y respondiendo a esta historia.