Las gafas AR están aquí, pero ¿qué pasa con las funciones auxiliares?

¿Se pueden llevar las experiencias multisensoriales un paso más allá?

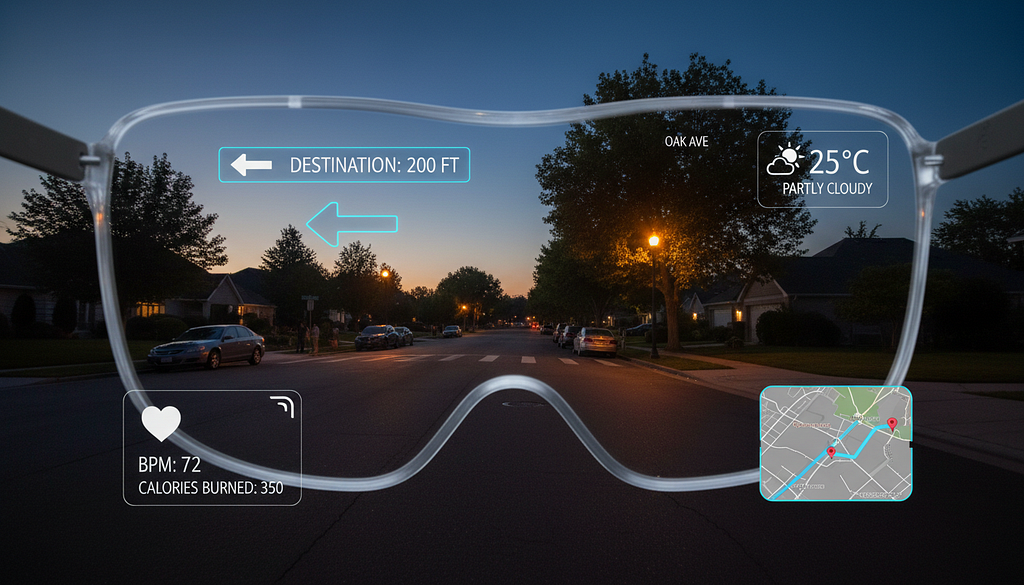

Grandes empresas como XREAL y Meta han lanzado nuevas gafas AR en los últimos meses. A diferencia de los voluminosos cascos de realidad virtual, son más livianos y cómodos, lo que significa que los usuarios pueden usarlos durante períodos de tiempo más prolongados. Yo mismo probé algunos de estos y, para ser honesto, todavía son un poco pesados (el mío seguía deslizándose por mi nariz grasienta). Pero dado lo rápido que avanza la tecnología, es posible que se estén reduciendo y volviéndose más populares pronto.

A medida que lo hagan, la accesibilidad será aún más importante. Podemos imaginar funciones básicas integradas como lectura de texto y conversión de voz a texto. Pero, ¿cómo podemos resolver este problema de forma más creativa? La RA tiene características diferentes a las pantallas 2D tradicionales, lo que significa que potencialmente tenemos más sentidos con los que jugar y más formas de involucrar (engañar) al cerebro. Es importante considerar esto mientras la tecnología aún se encuentra en las primeras etapas de desarrollo y los patrones de diseño están fijados.

Primero… ¿cómo funcionan las gafas AR?

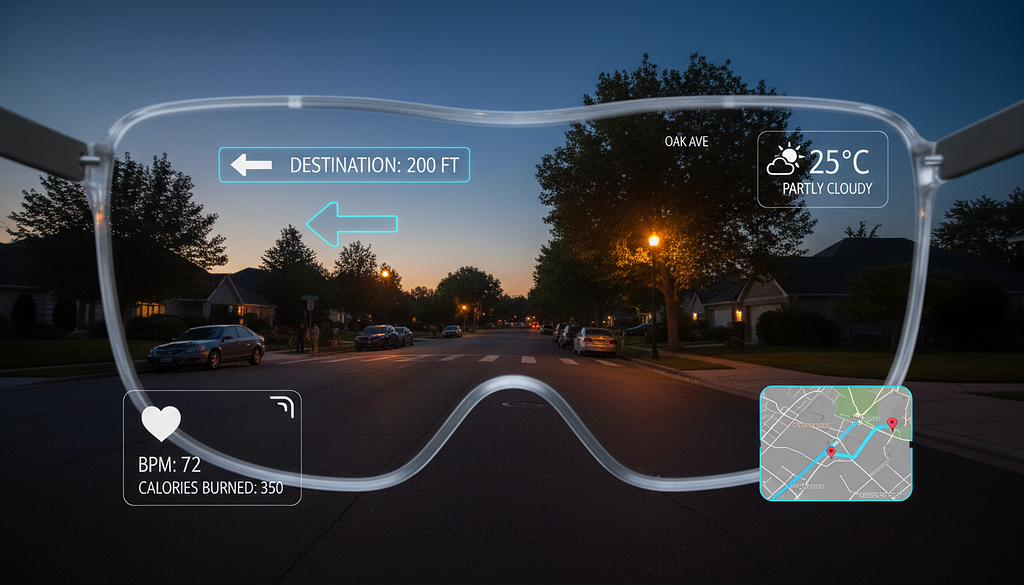

La funcionalidad más básica ahora es utilizarlos como segunda pantalla. Conéctese a su teléfono y podrá ver películas o jugar juegos en una pantalla más grande sin necesidad de un monitor físico. Las gafas AR también pueden superponer información directamente en el mundo real.

Hay varios componentes clave dentro de un par típico de gafas AR:

sistema de visualización

La mayoría de las gafas AR modernas utilizan tecnología de guía de ondas, que es una capa óptica delgada y transparente que guía la luz desde un pequeño proyector hacia los ojos y al mismo tiempo le permite ver el mundo real. Un pequeño proyector escondido dentro del brazo del marco genera la imagen y la proyecta desde el lateral hasta el borde de la lente. Luego, la luz pasa a través del vidrio mediante reflexión interna, rebota hasta llegar al acoplador externo y se libera hacia el ojo.

Cámaras, sensores y mapeo espacial

Las gafas AR combinan cámaras, sensores de movimiento y algoritmos de inteligencia artificial para crear un mapa 3D del entorno físico. Algunos modelos de alta gama también incluyen sensores de profundidad, que disparan pulsos láser invisibles y miden cuánto tiempo tardan en rebotar, lo que permite realizar un mapeo espacial más preciso.

sistema interactivo

Los micrófonos, cámaras y sensores de seguimiento ocular integrados permiten a los usuarios interactuar con el entorno mediante comandos de voz, control de la mirada y seguimiento de las manos.

correa para la muñeca (opcional)

La pulsera no es una parte central de las gafas AR, pero combina bien con las gafas AR. Cuando haces gestos, miden la actividad eléctrica de los músculos de tu muñeca y convierten esas señales en comandos digitales. A diferencia del seguimiento de manos basado en cámara en realidad virtual, la pulsera funciona incluso cuando las manos están quietas. fuera del marco, Hazlo más confiable. Muchos también incluyen retroalimentación háptica, que le brinda una respuesta física al interactuar con objetos virtuales.

¿Qué funciones de accesibilidad ya están disponibles?

Para los usuarios con baja visión, Meta AI en las gafas Ray-Ban presenta una función de “Respuesta detallada”, donde la inteligencia artificial describe su entorno o lee etiquetas en voz alta. Meta también está relacionado con se mis ojosuna aplicación que conecta a usuarios ciegos o deficientes visuales con voluntarios videntes a través de cámaras. Con las gafas de inteligencia artificial, simplemente dices “Hey Meta, Be My Eyes” para activarlas.

También hay una aplicación llamada vozque captura información continuamente a través de una cámara y mapea lo que ve en un paisaje sonoro. Proporciona a los usuarios información detallada en tiempo real sobre su entorno a través del sonido.

Para los usuarios sordos o con problemas de audición, las gafas inteligentes INMO GO AR pueden mostrar conversión de voz a texto en tiempo real e incluso admitir traducción en tiempo real.

No sólo para usuarios con discapacidad, sino para todos

Algunas de las características anteriores pueden beneficiar a todos, no sólo a las personas con discapacidad. Todos experimentamos algún tipo de limitación en nuestras vidas. Tómeme como ejemplo: como hablante no nativo, la conversión de voz a texto ayuda mucho cuando no puedo entender el acento de alguien o habla demasiado rápido. También me gusta usar texto más grande, texto a voz y ajustar el contraste cuando tengo los ojos cansados.

Tradicionalmente, las empresas solían diseñar primero la experiencia principal y luego agregar funciones para usuarios discapacitados o crear una versión completamente separada para ellos. Esto tiende a aislar a los usuarios con discapacidades y disminuir su experiencia. El diseño universal adopta un enfoque diferente. En lugar de ver la accesibilidad como una solución para grupos específicos, se requiere “¿Cómo diseñamos experiencias que sean mejores para todos?“Nuestro objetivo es hacer que los ajustes preestablecidos de productos sean accesibles para una variedad de personas y habilidades.

Juegos de vídeo El último de nosotros parte 2 Probablemente uno de los mejores ejemplos de diseño universal. El equipo incluyó un “modo de escucha mejorado” para ayudar a los usuarios a navegar por el mundo a través del sonido, la capacidad de habilitar la cámara lenta al apuntar a los enemigos y el uso de hápticos para que los usuarios puedan sentir realmente la entrega, el énfasis y la emoción de las líneas. Muchos jugadores sin discapacidades utilizan estas funciones, ya sea para ajustar la dificultad o simplemente para tener una experiencia diferente, y la respuesta ha sido muy positiva. Muchos jugadores dicen que estas características adicionales hacen que el juego sea más inmersivo y divertido. Cuando las características de accesibilidad están bien integradas, se sienten más como opciones que como adaptaciones.

Investigaciones anteriores sobre experiencias multisensoriales

Para experiencias más inmersivas que involucran múltiples sentidos, como AR o VR, es posible que tengamos más formas de lograr el objetivo de crear un diseño universal. Estos medios tienen el potencial de apelar a diferentes sentidos simultáneamente.

Nuestros sentidos no funcionan de forma aislada. Más bien, se influyen constantemente entre sí. Experimentos anteriores han demostrado cómo el cerebro combina información de diferentes sentidos para fortalecer las señales débiles.

El tacto mejora la audición

convertirse en uno experimentolos participantes escucharon un sonido mientras recibían un ligero toque en su piel. Los resultados muestran que el tacto puede ayudar a las personas a detectar sonidos débiles más fácilmente y hacer que los sonidos parezcan más fuertes de lo que realmente son. Los beneficios son más evidentes cuando el tacto y el sonido ocurren simultáneamente.

en otro experimentolos participantes realizaron una tarea sencilla de igualación de volumen en la que sintonizaban un tono suave hasta que sonaba tan fuerte como otro. A veces los participantes sostenían el tubo vibratorio mientras escuchaban, a veces no. Cuando sostuvieron el tubo de zumbido, constantemente ajustaron el tono para que fuera aproximadamente un 12 por ciento más silencioso que cuando no tocaron el tubo. En otras palabras, las vibraciones hacen que los sonidos parezcan más fuertes de lo que realmente son.

El sonido afecta la visión.

Tradicionalmente se ha pensado que la visión es el sentido dominante, pero las investigaciones muestran que el sonido puede remodelar lo que vemos. convertirse en uno experimentocuando un flash se combina con varios pitidos, las personas informan haber visto varios flashes, aunque en realidad solo ocurre uno. Cuantos más pitidos se emitieron, más destellos de luz la gente informó haber visto.

El tacto afecta el peso percibido

convertirse en uno experimentoLos investigadores dieron a las personas objetos del mismo peso pero con diferentes materiales de superficie. Los objetos fabricados con materiales de mayor densidad, como el aluminio, se consideran más ligeros, mientras que los objetos fabricados con materiales de menor densidad, como la espuma plástica, se consideran más pesados. Sin embargo, esto sólo funciona con objetos más ligeros, ya que los objetos más pesados requieren un agarre firme, lo que anula las señales táctiles. Esto sugiere que el cerebro mide el peso en parte leyendo el material de la superficie que toca el dedo.

Todo esto sugiere que puede haber más formas de resolver los problemas de accesibilidad de las que estamos acostumbrados. Aprovechar los múltiples sentidos aumenta la accesibilidad y mejora la experiencia general. uno estudiar El descubrimiento de que las configuraciones hápticas de audio visual brindan constantemente una mejor experiencia de usuario que las experiencias puramente visuales o de audio visual muestra la promesa de esta dirección.

Todos experimentamos algún tipo de restricción en nuestra vida diaria, algunas son más comunes que otras. No queremos comprometer la experiencia, por eso los diseñadores y desarrolladores deben pensar creativamente en función del nuevo potencial y características de cada tecnología. Tenemos la responsabilidad de brindar una experiencia completa a cada usuario, independientemente de sus circunstancias.

referirse a:

- Sean mis ojos. (Dakota del Norte). Sean mis ojos de gafas inteligentes. https://www.bemyeyes.com/be-my-eyes-smartglasses/

- Meijer, P. (sin fecha). Voz para Android (Aplicación móvil). Tienda Google Play. https://play.google.com/store/apps/details?id=vOICe.vOICe&hl=en

- Perro travieso. (2020). The Last of Us Parte II (Videojuegos). Entretenimiento interactivo de Sony.

- Schürmann, M., Caetano, G., Jousmäki, V. y Hari, R. (2004). Hands Aid Hearing: Promueve la interacción auditivo-táctil a niveles de baja intensidad. Revista de la Sociedad Acústica de América, 115(2), 830–832. https://doi.org/10.1121/1.1639909

- Shams, L., Kamitani, Y. y Shimojo, S. (2000). Alucinación: lo que ves es lo que oyes. naturaleza, Capítulo 408(6814),788. https://doi.org/10.1038/35048669

- Ellis, RR y Lederman, SJ (1999). La ilusión del peso material revisada. Percepción y Psicofísica, 61(8), 1564-1576. https://doi.org/10.3758/BF03213118

- Wei, Q. y Zuo, T. (2025). Diseño y evaluación de experiencias hápticas en serious games de realidad aumentada para móviles. Revista de interfaz de usuario multimodal, 19411–440. https://doi.org/10.1007/s12193-025-00467-y

- Gilmeister, H. y Eimer, M. (2007). Mejora táctil de la detección auditiva y el volumen percibido. Investigación del cerebro, 1160, 58-68. https://doi.org/10.1016/j.brainres.2007.05.067

Las gafas AR están aquí, pero ¿qué pasa con las funciones auxiliares? Publicado originalmente en colectivo de experiencia de usuario En Medium, la gente continúa la conversación destacando y respondiendo a esta historia.