No es nuestra intención construir este compromiso a toda costa.

No fue nuestra intención crear esto: participación a cualquier costo.

Cómo los diseñadores bien intencionados se vuelven cómplices de romper sistemas y por qué entregar esos mismos encargos a la inteligencia artificial puede tener consecuencias desastrosas.

Buenas intenciones, sistema roto

El 24 de marzo de 2026, un tribunal de Nuevo México multó a Meta con 375 millones de dólares por engañar a los usuarios sobre la seguridad de su plataforma. Para una organización multimillonaria, eso es el equivalente a una multa por exceso de velocidad. Pero lo que hace que el fallo histórico sea tan interesante es que el argumento ganador arrojó dudas sobre las características de diseño de sus aplicaciones y dijo que eran culpables de acusaciones como no proteger a los menores.

Lamentablemente, en realidad no aprendemos nada que no sepamos ya; no aprendemos nada. Existe amplia evidencia de que las aplicaciones de redes sociales pueden exacerbar las tendencias adictivas e impactar negativamente el comportamiento personal. Aunque los directores ejecutivos de tecnología lo niegan, A menudo restringen severamente las aplicaciones y dispositivos que pueden usar sus hijos.

Entonces, ¿cómo llegaron a este punto los diseñadores de productos que se enorgullecen de utilizar la investigación y la evidencia de los usuarios para fundamentar sus decisiones? Todavía tengo que conocer a un diseñador que busque activamente crear un producto que sepa que es dañino; de hecho, el diseñador quiere complacer a sus usuarios, entonces, ¿qué factores impulsan a las organizaciones a terminar en esta situación? Como diseñadores, ¿somos cómplices?

Esta no es una nueva fragilidad humana. Rutger Bregman afirma en su libro de 2020 Humanidad: una historia llena de esperanza Los individuos son esencialmente decentes, pero son capaces de cometer cosas terribles si creen que están haciendo el bien. Como escribe Bregman: “Si presionas lo suficiente a la gente, si empujas, pinchas, provocas y manipulas, muchos de nosotros somos realmente capaces de hacer el mal. El camino al infierno está pavimentado de buenas intenciones”. Esto suena incómodo, pero parece cierto, porque los diseñadores de buenas intenciones terminan inmersos en sistemas que causan un daño real.

Demos un paso atrás y observemos la trayectoria general de la experiencia de las grandes tecnologías en las últimas décadas. Las organizaciones que alguna vez defendieron experiencias de usuario sin esfuerzo para atraer clientes ahora han cambiado radicalmente esa propuesta. Los clientes de ecosistemas cerrados ahora son el objetivo de obtener ganancias a toda costa y deben soportar una experiencia peor y más costosa simplemente porque salir es muy inconveniente. Esto se llama “decadencia de la plataforma”, pero es posible que esté más familiarizado con este término más colorido. Cory Doctorow acuñó el término “enshittificación” para describir exactamente este efecto.

Entonces, ¿qué es esta tormenta perfecta que provoca estos resultados inesperados pero reprensibles? Por lo general, comienza con una definición de éxito, que es una matriz de numerosas métricas de usuarios comprometidos, junto con objetivos agresivos de crecimiento y retención. La matriz actúa como un indicador de los indicadores de ganancias, y priorizar la obtención de ganancias rápidamente supera a cualquier otro factor. El costo humano de lograr estos objetivos no se refleja en el tablero. Ahora, al diseñar las palancas adecuadas, la resolución objetivo se convierte en el número que se debe alcanzar al final del trimestre.

“El costo humano de lograr estos objetivos no se refleja en el tablero”

Ignorar los problemas que “podrían” surgir después de alcanzar las metas no se considera preocupante porque no son los problemas de hoy. De hecho, se consideran “buenos problemas” que pueden resolverse en el futuro si podemos. Pero a través de ganancias incrementales, estos objetivos pronto aparecerán en el espejo retrovisor del producto.

Cuando el motor está funcionando a toda velocidad, nadie quiere perder potencia. Los incentivos financieros, las presiones de tiempo trimestrales y las presiones del mercado externo impregnan una cultura que ignora cualquier recurso pero abraza con entusiasmo el mantra de “moverse rápido y romper cosas”. Empieza a hacerse evidente cómo estas matrices de éxito dan forma al resumen de diseño.

Esto es común en el mundo de la tecnología y lo hemos visto en un grado similar cuando la seguridad se ha visto comprometida en productos como cámaras de timbre o Los juguetes infantiles conectados tienen un enorme defecto de seguridadporque la protección siempre ocupa el segundo lugar en la matriz del éxito. La alarma surge porque las consecuencias son más inmediatas y más fáciles de detectar que los algoritmos tóxicos integrados como características centrales de productos que generan miles de millones de dólares en ingresos.

El problema de crear un espacio así es que no sólo permite que se manifiesten resultados indeseables, sino que también hace que su manifestación sea inevitable.

¿Dónde encajan los diseñadores en todo esto? Nuestro objetivo es crear palancas de productos exitosas que impulsen estas métricas. Pero al centrarnos estrictamente en el diseño del apalancamiento, solo vemos esos objetivos trimestrales que se avecinan, luego nos ponemos las anteojeras y comenzamos a correr hacia la línea de meta.

Cuando avanzamos con un encargo roto y tan estrechamente alineado con las ganancias, es fácil justificar tomar atajos y alejarnos de la intención original. Las recompensas aumentan cada vez más con cada paso que das, hasta que te adelantas a prácticas cuestionables y las autoridades te detienen por peligro imprudente.

Necesitamos preguntarnos: ¿es este el punto final correcto? Esta pregunta se vuelve aún más relevante cuando el encargo no se entrega a un diseñador sino a un agente.

caja negra

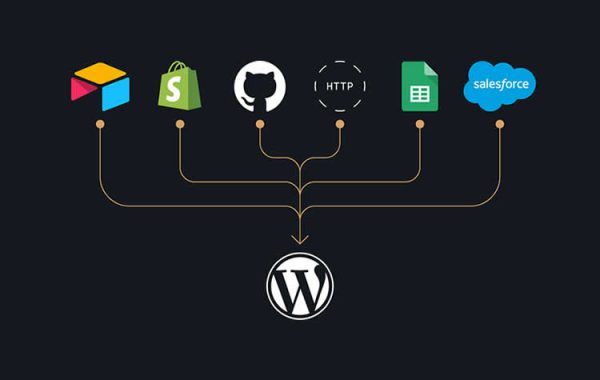

Si seguimos desviándonos por culpa de estas bragas rotas, ¿qué pasará cuando queramos hacerlo rápidamente y a escala? Cuando pasamos estos informes defectuosos a los agentes de IA, ¿estamos exacerbando el problema?

Un modelo de IA no es determinista porque no sabemos exactamente qué producirá, incluso si le proporcionamos los mismos datos. Entonces, cuando un agente de IA hereda un informe defectuoso, pasa su interpretación a otro, y así sucesivamente, en una serie de cajas negras que se informan entre sí; cada paso puede introducir sesgos, y después de algunos agentes podemos encontrar que nuestras intenciones originales han sido severamente diluidas o simplemente mal entendidas. Esta premisa hace que el escenario de maximización de clips de Nick Bostrom, en el que una inteligencia artificial tiene la tarea de fabricar clips pero finalmente convierte toda la materia (incluidos los humanos) en clips, parezca que podría ser real.

“Una serie de cajas negras que se informan entre sí; cada salto puede introducir sesgos”.

A través del diseño, la inteligencia artificial busca soluciones novedosas y, al fomentar este comportamiento, nosotros, como seres humanos, buscamos superar los límites de la generación de soluciones creativas. Pero cuando combinamos la necesidad de innovación con un compromiso óptimo, sin un marco ético claro que establezca límites y restricciones, es poco probable que estemos preparados para los resultados que producirá el sistema.

El riesgo aumenta aún más por el hecho de que los productos son cada vez más baratos de construir, por lo que vemos que cada vez más organizaciones se saltan la creación de prototipos y pasan directamente a las pruebas de población de campo. La base de usuarios se convierte en una placa de Petri; Los momentos de revisión ética son reemplazados por resultados estadísticamente significativos.

¿Qué tan inhumano se vuelve un sistema? Cuando se toman decisiones clave a lo largo de toda la cadena de agentes, cada decisión puede racionalizarse localmente, pero ¿quién supervisa toda la cadena de agentes?

En el caso de Meta, si avanzamos unos años, supongamos que estas características mal diseñadas fueron orquestadas y creadas por un agente de IA, y que nadie tuvo la intención de causar este daño, ni hubo ninguna intención maliciosa directa en el mensaje, ni hubo una sola decisión que sirvió como clave para asignar responsabilidad, ¿quién fue el responsable? ¿Agencia gestora de diseñadores? ¿Una empresa que establece objetivos métricos positivos? ¿No hay un equipo de operaciones para ejecutar la gobernanza? ¿O todos los miembros de la cadena no lograron detenerlo?

¿Quién tiene la culpa?

Las herramientas existen. La voluntad no.

Los marcos éticos existen desde hace muchos años. Hay muchos marcos famosos como diseño sensible al valoreste Kit de herramientas de ética de Santa Clara, Código de ética del diseñador, Diseñar éticamente;Todos estos son un conjunto de herramientas prácticas para prácticas de diseño ético, pero en gran medida se ignoran en las organizaciones.

La aplicación de estos marcos en la práctica crea algunas “fricciones éticas” costosas y puede obstaculizar el crecimiento, introducir salvaguardias para los usuarios, reduciendo las métricas de participación a largo plazo y, de hecho, impactar las ganancias. En última instancia, no se trata de una falta de comprensión o conocimiento, sino de que la elección se reduce a personas versus ganancias, y las ganancias frente a las personas son elegidas una y otra vez.

La incómoda verdad es que no existe ningún incentivo comercial para adoptar ese marco y, seamos honestos, nosotros, como diseñadores, somos cómplices.

El fallo Meta es un indicador de que la aplicación de las regulaciones está por llegar, y las grandes tecnológicas han disfrutado de un almuerzo gratis a expensas de los usuarios durante demasiado tiempo; Les guste o no, los individuos ya no se quedarán de brazos cruzados mientras son vendidos y explotados injustamente.

Otro ejemplo similar es el de la Unión Europea, donde los reguladores europeos han ido más allá de las políticas de datos GDPR y han comenzado a hacer cumplir la Ley de Servicios Digitales (DSA) en cuestiones relacionadas con el diseño. X multado con 120 millones de euros por su marca azulesta característica de diseño viola la DSA, engaña a los usuarios y los expone a más estafas.

Ley de equidad digital El (DFA) que se está redactando actualmente tiene como objetivo brindar mayor claridad al describir los problemas de patrones oscuros, diseños adictivos, personalización y elaboración de perfiles injustos, marketing de influencia engañoso, precios injustos y procesos de suscripción y cancelación digitales.

“Cada vez que decidimos no aplicar estos marcos éticos, elegimos ser cómplices”.

A medida que la inteligencia artificial redefine cómo funciona el diseño y a los agentes se les asignan más responsabilidades, existe un mayor riesgo de que los diseños no controlados puedan conducir rápidamente a consecuencias “no deseadas”. Estos resúmenes de diseño son nuestra oportunidad para aclarar nuestra dirección, articulando claramente los resultados que buscamos y los resultados y consecuencias que lograremos. No aceptado O obvio. Estas no son restricciones, sino nuestras líneas rojas, las barandillas que construimos para mantener seguros a nuestros usuarios.

Los marcos éticos no son nuevos, el conocimiento y el conjunto de herramientas han estado ante nosotros durante muchos años y las regulaciones llegarán de todos modos. Como diseñadores, cada vez que decidimos no aplicar estos marcos éticos, ya sea en nuestros diseños o en las sesiones informativas para las agencias, elegimos ser cómplices.

Las buenas intenciones no son suficientes, construir mejor requiere que tomemos medidas: ser más críticos y decidir qué implementar, qué debemos cuestionar y, en última instancia, qué debemos decir que no.

Lecturas adicionales sobre este tema

- Los líderes tecnológicos pueden hacer más para evitar consecuencias no deseadas Reportado por Wired (mayo de 2022)

- Darle voz a la gente en un mundo impulsado por las ganancias Por People Nerds (septiembre de 2021)

- ¿Somos todos esencialmente buenos? Filósofo. Entrevista con Rutger Bregman (noviembre de 2021)

- ¿Gran Bretaña ya no está enamorada de las redes sociales? Por Dan Milmo Editor de tecnología global, The Guardian (abril de 2026)

No es nuestra intención construir este compromiso a toda costa. Publicado originalmente en colectivo de experiencia de usuario En Medium, la gente continúa la conversación destacando y respondiendo a esta historia.