La importancia estadística es diferente de la importancia práctica.

Resumen:

La significancia estadística ayuda a determinar si un resultado es confiable, mientras que la significancia práctica ayuda a determinar si un resultado justifica la acción.

Cuando realiza un estudio de usabilidad cuantitativo o una encuesta analítica, es fácil entusiasmarse cuando los resultados son estadísticamente significativos. Pero antes de celebrar, hagamos una pausa: la significancia estadística no significa automáticamente que los resultados importen en la práctica.

En la investigación de la experiencia del usuario, lo que es estadísticamente significativo puede no significar nada para los usuarios, los equipos de productos o los resultados comerciales.

¿Qué es la significancia estadística?

La significación estadística responde a las siguientes preguntas: ¿Podría este resultado deberse al azar?

Importancia estadística Lo que significa que es poco probable que los resultados hayan ocurrido por casualidad. Más específicamente, la posibilidad de que el resultado se deba al azar (también llamado valor p) es menor que un umbral preestablecido (generalmente 0,05).

Cuando realiza una prueba de significación estadística (por ejemplo, compara tasa de conversión Entre dos páginas web, estás probando si las diferencias que ves pueden ser aleatorias. Si la prueba arroja un valor p inferior a 0,05, el resultado es estadísticamente significativo, lo que indica que es poco probable que la diferencia sea aleatoria.

En otras palabras, si realiza el mismo experimento varias veces en condiciones similares, aún puede esperar ver resultados similares.

De eso se trata la significación estadística. No dice qué tan grande, valioso u obvio es el impacto para los usuarios o las empresas.

La significación estadística puede no ser importante

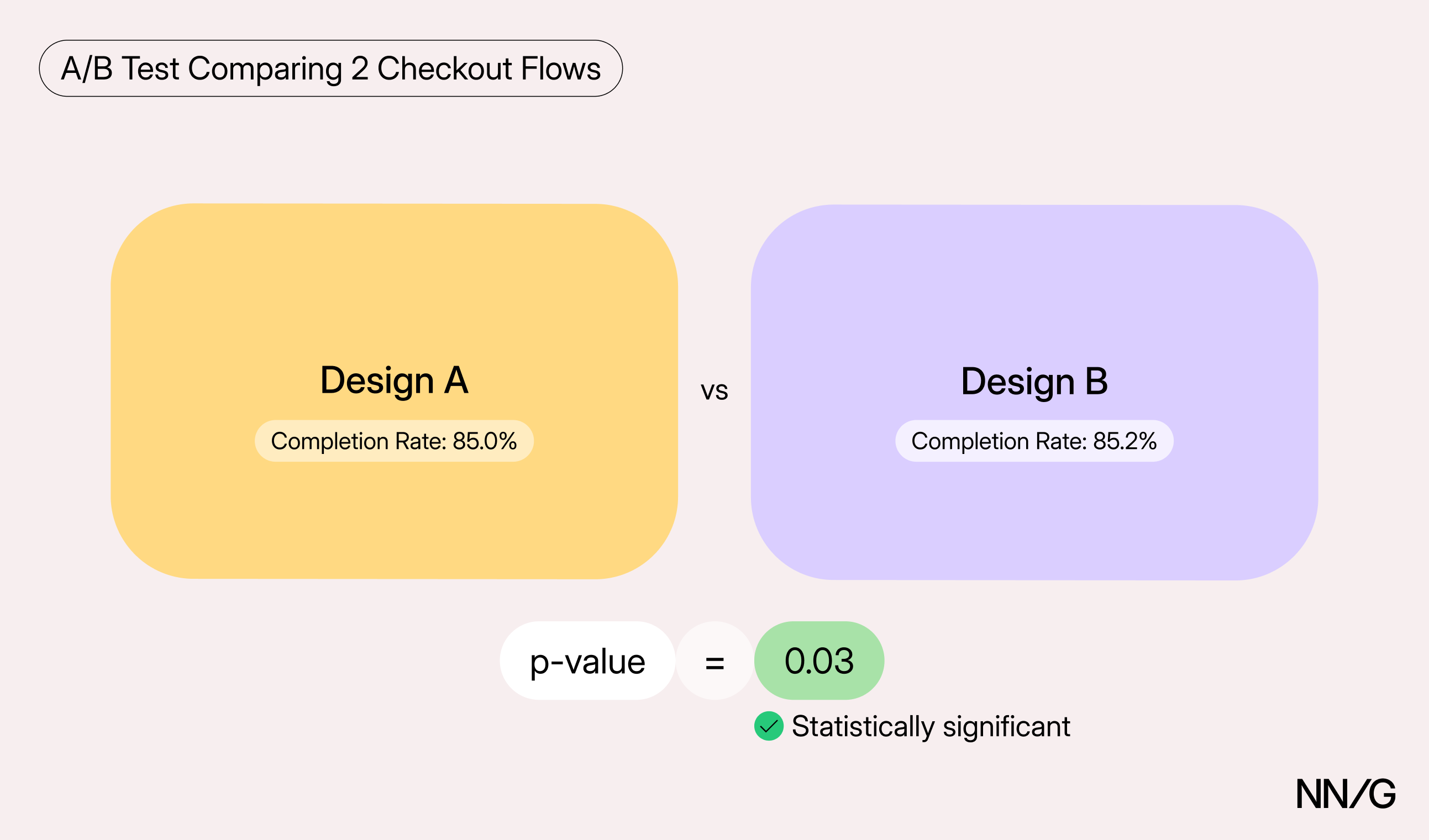

Aquí hay un ejemplo. Supongamos que ejecuta un Pruebas A/B Compare las tasas de finalización entre dos procesos de pago.

- Diseño A: Tasa de finalización 85,0%

- Diseño B: Tasa de finalización 85,2%

Realiza una prueba estadística para ver si la diferencia entre las dos tasas de finalización es estadísticamente significativa y obtiene un valor p de 0,03.

Debido a que el valor p es inferior a 0,05, la diferencia en las tasas de finalización es estadísticamente significativa. Esto significa que si hipotéticamente volviéramos a realizar el mismo estudio, podríamos esperar resultados similares. Esta confiabilidad es valiosa porque nos dice que los patrones que estamos viendo son reales. Vemos que no es sólo suerte.

Sin embargo, Fiabilidad e influencia no son lo mismo. En este ejemplo, la tasa de finalización del Diseño B es sólo un 0,2% más alta que la del Diseño A. También debemos preguntarnos si este efecto es lo suficientemente grande como para marcar la diferencia.

La significancia estadística no nos dice si la diferencia es perceptible para los usuarios, significativa para la experiencia o si tiene un impacto comercial. Es por eso que también debemos considerar las implicaciones prácticas: decidir si los resultados estadísticamente confiables merecen la pena tomar medidas en el mundo real.

¿Cuál es el significado práctico?

significado práctico Se hace una pregunta diferente y más práctica: ¿Es este resultado lo suficientemente importante en la vida real?

significado práctico Esto se refiere a una diferencia observada que es lo suficientemente grande como para tener un impacto significativo en las decisiones del mundo real, la experiencia del usuario u otros resultados.

Incluso si un resultado es estadísticamente significativo, el impacto puede ser demasiado pequeño para justificar un cambio de diseño, lo que significa que no tiene importancia práctica.

Suponga que prueba dos diseños de pago y descubre que el Diseño B reduce el tiempo promedio de la tarea de 55 segundos a 54 segundos.

Esta diferencia de 1 segundo podría ser estadísticamente significativa si la muestra es lo suficientemente grande, pero ¿mejora significativamente la experiencia del usuario en el mundo real o las métricas comerciales? Probablemente no, especialmente si la mejora requiere trabajo de ingeniería adicional, corre el riesgo de introducir nuevos errores o agrega fricción innecesaria al diseño para una ganancia de velocidad apenas perceptible.

Por el contrario, un efecto estadísticamente insignificante puede ser lo suficientemente grande como para causar preocupación. Por ejemplo, si la muestra pequeña Pruebas de usabilidad cuantitativa Se demostró que la tasa de finalización de tareas disminuyó en un 80% después del cambio de diseño, por lo que podría ser una buena idea realizar más investigaciones o pruebas, incluso si los resultados no alcanzaron significación estadística.

Es importante destacar que esto también significa que no todo lo importante en la experiencia del usuario puede (o debe) reducirse a valores p. Muchos conocimientos impactantes sobre la experiencia del usuario provienen de investigaciones cualitativas: observar las luchas de los usuarios, escuchar su razonamiento o notar patrones de comportamiento que son perceptibles sin grandes muestras o pruebas estadísticas. La significancia estadística es útil, pero es sólo una pieza del rompecabezas de la evidencia.

El papel del tamaño de la muestra

1. Los tamaños de muestra grandes pueden hacer que las pequeñas diferencias parezcan “significativas”

Cuando se trata de grandes conjuntos de datos cuantitativos (por ejemplo, datos de análisis de miles o incluso millones de sesiones) Incluso pequeñas diferencias pueden mostrar significación estadística.

Por ejemplo, digamos que su equipo de producto modifica un campo de formulario y la tasa de error cae un 0,03%. Para muestras grandes, este pequeño cambio puede producir un valor de p inferior a 0,001, lo que indica significación estadística.

¿Pero alguien notaría una diferencia del 0,03% en el uso real? En este caso particular, probablemente no. En realidad, la caída del 0,03% es tan pequeña que la experiencia es efectivamente la misma.

A medida que aumenta el tamaño de la muestra, aumenta la capacidad de detectar resultados estadísticamente significativos.incluso si el impacto es insignificante. Por otro lado, la importancia práctica reside en el tamaño real y el impacto del efecto. – en lugar de si las fórmulas estadísticas sugieren que es poco probable que sea una casualidad.

Ambos conceptos son importantes en la investigación de la experiencia del usuario, pero tienen propósitos diferentes. Los conjuntos de datos grandes son particularmente propensos a malinterpretar “estadísticamente significativo” como “importante”. Por lo tanto, siempre que un resultado sea estadísticamente significativo, también debemos preguntarnos: ¿Es la diferencia lo suficientemente significativa como para importarle a los usuarios?

2. Los tamaños de muestra pequeños pueden ocultar patrones significativos

A veces, debido a limitaciones de tiempo o presupuesto, solo podemos recolectar una muestra pequeña, por ejemplo menos de 15 participantes. Con una muestra tan pequeña, lograr significancia estadística es extremadamente difícil (y a veces imposible). Las matemáticas simplemente no están de nuestro lado. Esto se debe a que las muestras pequeñas son más susceptibles al ruido, los valores atípicos y los comportamientos idiosincrásicos de un pequeño número de participantes.

Sin embargo, en algunos casos, los estudios cuantitativos con muestras pequeñas pueden seguir teniendo importancia práctica. Esta es una consideración importante para los equipos de UX con tiempo y presupuesto limitados.

Esto tiende a ocurrir cuando el patrón es inusualmente grande y consistente. Por ejemplo, suponga que está probando dos diseños de tablero nuevos con 12 personas. Si 10 de cada 12 personas no completan una tarea en el Panel A, pero solo 1 de cada 10 personas en el Panel B no logran completar una tarea, la diferencia puede no ser “estadísticamente significativa”, pero es difícil de ignorar desde una perspectiva práctica. El tamaño de la brecha indica que el Panel A no es totalmente compatible con el usuario.

Aquí es donde las implicaciones prácticas nos ayudan a llenar los vacíos, especialmente si podemos combinar resultados cuantitativos con evidencia cualitativa. Nos anima a examinar su importancia y significado. Lo que observamos. Si los usuarios se confunden constantemente, se atascan o cometen los mismos errores, es una evidencia significativa a la que vale la pena prestar atención.

Cómo evaluar la importancia práctica

Al evaluar las implicaciones prácticas, es importante recordar El significado real depende del contexto. Pequeñas diferencias numéricas pueden importar o no importar en absoluto, dependiendo de la escala. Por ejemplo, supongamos que un cambio de diseño aumenta los ingresos por conversión en 2 USD. Si su valor de conversión promedio es de $1000, ese aumento de $2 puede volverse significativo cuando se multiplica por miles o millones de conversiones por año. Pero si el valor de cada conversión ya es de 1.000.000 de dólares, entonces un aumento de 2 dólares probablemente sea insignificante.

El equipo de experiencia del usuario puede evaluar la importancia práctica de tres maneras.

1. Percepción del usuario

preguntar: ¿Los usuarios reales notarán este cambio?

Incluso si los resultados son estadísticamente significativos, es posible que no tengan un impacto significativo en la experiencia. considerar:

- ¿Los usuarios encontrarán la interfaz más rápida o fluida?

- ¿Reducirá esto la frustración, la vacilación o la confusión?

- ¿Este cambio cambiará significativamente el comportamiento del producto?

Por ejemplo, imagine un rediseño que técnicamente carga la página 8 milisegundos más rápido. Estadísticamente, esta diferencia podría parecer “significativa”, pero en este caso nadie percibiría conscientemente una mejora de 8 milisegundos. Para el usuario, la página se siente exactamente igual. Si el efecto es demasiado pequeño para que la gente lo note, probablemente no merezca prioridad.

2.Valor empresarial

preguntar: ¿Es esta diferencia importante para la organización?

Los resultados pueden ser de importancia práctica si impactan resultados comerciales importantes. considerar:

- ¿Ahorrará tiempo, dinero o enormes recursos de soporte?

- ¿Puede reducir los errores o el abandono en flujos de trabajo de alto riesgo?

- ¿Mejora las métricas clave (por ejemplo, conversión, retención, éxito de la misión) lo suficiente como para justificar la implementación?

Las pequeñas mejoras pueden agravarse en un entorno de gran volumen, mientras que las mejoras más grandes pueden no importar si no respaldan los objetivos estratégicos.

Por ejemplo, digamos que un cambio solo reduce los errores de pago en un 0,5%. Por sí solo, esto puede parecer poco. Pero si su producto maneja 2 millones de pagos por año, habrá 10,000 transacciones fallidas menos. Si cada pago fallido le cuesta a la empresa $15 en ingresos perdidos o tiempo de soporte, esta pequeña mejora equivale a $150 000 por año.

En este caso, el efecto puede ser sutil para los usuarios individuales, pero a escala tiene un valor práctico claro para el negocio y merece prioridad.

3. Tamaño del efecto

El tamaño del efecto es un cálculo estadístico que indica qué tan grande o significativa es realmente la diferencia. Si el impacto para el usuario y el valor comercial son claros, es posible que no necesite un cálculo formal del tamaño del efecto. Los tamaños de los efectos se vuelven más valiosos cuando los resultados no son claros, las compensaciones son costosas o cuando se necesita una forma cuantitativa confiable de comunicar los tamaños de los efectos a las partes interesadas.

Dependiendo del tipo de datos, existen varias formas de calcular el tamaño del efecto. Si bien una discusión de estas técnicas está más allá del alcance de este artículo, los métodos incluyen d de Cohen, índice de riesgos instantáneos, índice de probabilidades o coeficiente de correlación.

combinar dos perspectivas

Los investigadores siguen la mejor experiencia de usuario Ambos Importancia estadística y significación práctica:

- La significación estadística garantiza que sus hallazgos no sean aleatorios.

- Las implicaciones prácticas garantizan que sus hallazgos sean dignos de acción.

Juntos, equilibran la confianza y la influencia y, en última instancia, basan las elecciones de diseño en los datos que realmente importan.

en conclusión

En la investigación sobre la experiencia del usuario, la significación estadística y la importancia práctica responden a preguntas diferentes pero igualmente importantes. La significancia estadística muestra si es probable que un resultado sea cierto, mientras que la significancia práctica nos ayuda a decidir si vale la pena tomar medidas. Centrarse en solo uno puede llevar a desperdiciar recursos en cambios triviales o ignorar problemas de usabilidad significativos. Al combinar los valores p con el significado real, los equipos de UX pueden tomar decisiones seguras y equilibradas y priorizar cambios que no solo sean estadísticamente confiables, sino que realmente mejoren la experiencia del usuario e impulsen el valor comercial.