¿La inteligencia artificial nos está entrenando para ser mejores pensadores críticos?

El auge de los usuarios escépticos en la era de los medios sintéticos

He estado siguiendo de cerca la discusión sobre el contenido generado por IA. Mi hipótesis inicial sobre las redes sociales era simple: si los algoritmos nos dirigen hacia preferencias cómodas y familiares, eliminarán los matices y el pensamiento crítico. Pero eso no es lo que sucede con los medios sintéticos.

El director de Instagram, Adam Mosseri, señaló recientemente en su artículo prosa Estamos pasando de asumir que lo que vemos es real a comenzar con la duda. Sugiere que desviemos nuestra atención de Qué Compartiendo con Organización Mundial de la Salud lo está compartiendo.

Mosseri reconoció que las plataformas “empeorarán” en la detección de contenido de IA con el tiempo a medida que la tecnología mejore, pero sugirió que Instagram se convierta en el árbitro de la autenticidad a través de un sistema de verificación.

Mientras las plataformas luchan por encontrar curitas técnicas, a mí me interesan más los subproductos: El auge de los usuarios escépticos.

Datos no confiables

No sólo imaginábamos este cambio, los números lo confirman:

- La confianza en las organizaciones de noticias nacionales ha disminuido 76% 2016 a 56% 2025 (Centro de Investigación Pew, 2016, 2025).

- 70% de los jóvenes descubren algo por accidente (accidentalmente) en lugar de buscar información para verificarlo (Pew Research Center, 2025).

- 59% Reconociendo que ya no pueden distinguir de manera confiable entre contenido humano y de IA (Deloitte, 2024).

- 70% de los usuarios dice que la IA hace que sea más difícil para las personas confiar en lo que ven (Deloitte, 2024).

Dos presiones clave que enfrentan los diseñadores de productos

La detección confiable de IA aún está por llegar

La magnitud del problema es invisible hasta que se vuelve invisible. Según un informe de 2026 de Kapwing, 21% de los vídeos El contenido que se muestra a los nuevos usuarios de YouTube ahora se clasifica como basura de IA. Este contenido sintético de baja calidad se crea únicamente para captar la atención.

C2PA (Firma criptográfica) es una solución técnica propuesta que “firmará” archivos de manera efectiva para demostrar su autenticidad. Un obstáculo importante es que la tecnología actualmente solo funciona en un puñado de dispositivos, lo que podría crear una Internet de dos niveles.

Por ejemplo,

- Abres una aplicación como ChatGPT Video Generator en tu iPhone para crear un video completamente compuesto: momentos auténticos y en bruto de tu reacción a las noticias.

- El video generado por IA se guardará en su aplicación Fotos como un archivo .mp4 o .mov estándar, que contiene metadatos básicos (fecha, tipo de dispositivo, posiblemente nombre de la aplicación).

- Lo subes directamente a Instagram.

Lo que falta:

- No hay ninguna firma criptográfica que demuestre que fue capturado por el sensor de la cámara.

- No existe una cadena de custodia C2PA que indique que se originó a partir de imágenes reales.

Si un creador con un dispositivo sofisticado tiene una insignia de “verificado y auténtico”, ¿todos los demás se convertirán en sospechosos por defecto? Debemos tener cuidado de no convertir la autenticidad en una característica de propiedad. metavalidación Nos muestra lo que sucede cuando la verificación paga convierte la confianza en un producto que cualquiera puede comprar.

Paradoja de Wikipedia

La inteligencia artificial nos ha entrenado sin darnos cuenta para actuar como editores de Wikipedia. En su nuevo libro, Siete reglas de confianzaJimmy Wales cree que la confianza no es una insignia estática, sino un proceso vivo. La confianza se basa en la transparencia, la neutralidad y la verificación de múltiples fuentes.

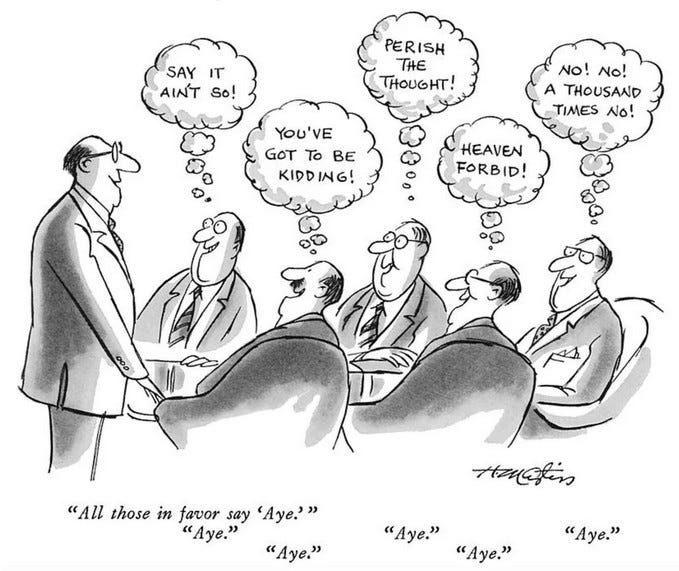

Las redes sociales han experimentado un auge a lo largo de los años. Ignorancia pluralista. Esta es una trampa psicológica. Dudas secretamente de una publicación. Te preguntas si esto es inteligencia artificial, pero te quedas en silencio. No lo grites públicamente. Ni siquiera te gustó la publicación. En su lugar, puedes enviárselo a un amigo por DM. Seguimos siendo escépticos en nuestro chat grupal.

Antes de la era de la rampa: Vi una noticia convincente → La compartí con mis amigos.

Después de la era de la rampa: Veo contenido interesante → compruebo la credibilidad del autor → reviso el perfil → (tal vez) busco una segunda fuente → luego asumo que es auténtica.

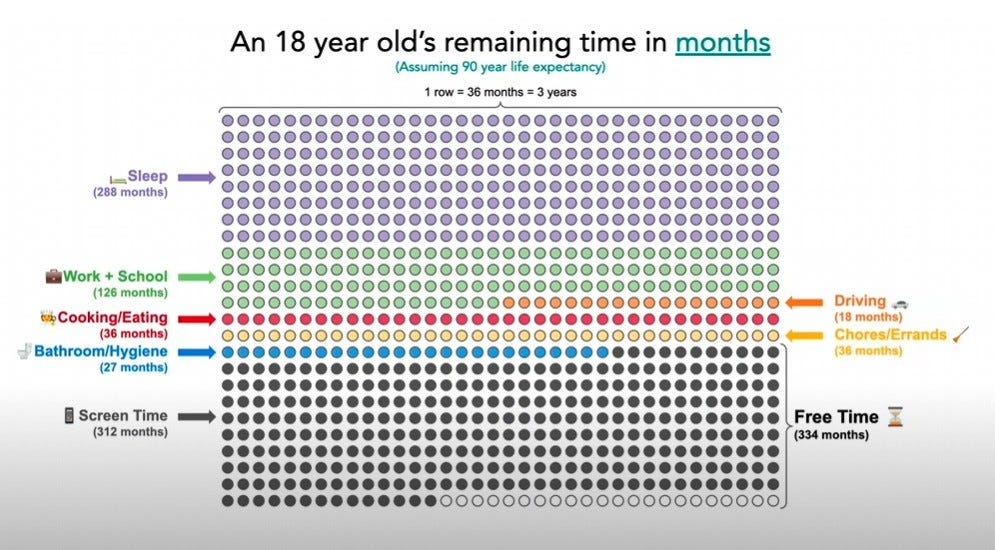

Dino Ambrosi (TEDx, lucha por tu tiempo) muestra que los jóvenes de 18 años están acelerando su consumo 93% del tiempo libre restante Mira fijamente la pantalla.

Podemos deducir que cuanto más tiempo pasemos en un entorno saturado de IA, más probable será que el engaño digital se convierta en nuestra realidad. La paradoja de Wikipedia sugiere un camino a seguir. usuario pensar Recibo. Nuestros diseños no deberían ser simples insignias “verificadas” Leer horizontalmente.

“Créanos, este es un creador probado”. (Basado en veredicto)

“Esta es la historia de ese creador, sus cuentas asociadas y dónde se vio la imagen por primera vez”. (Basado en evidencia)

Diseñado para la duda, no solo para la confianza

Como diseñadores, nos encontramos en una encrucijada: ¿construimos sistemas que piensan para los usuarios o sistemas que ayudan a los usuarios a pensar por sí mismos? Éticamente, nuestro papel no es reemplazar el comportamiento crítico emergente con una insignia de confianza. es amplificarlo.

¿Cómo están resolviendo este problema las plataformas de redes sociales ahora?

- Tiktok esta aplicando para mimarca de agua invisible. Se trata de una técnica forense que incorpora firmas ocultas en píxeles de vídeo. Si un usuario graba un vídeo en la pantalla, TikTok aún puede identificar su fuente.

- Yuan se unió Comité Directivo de C2PA Finales de 2024. Están trabajando en metadatos de procedencia para archivos digitales, donde los usuarios pueden verificar su procedencia e historial.

- youtube es Pide a los creadores que revelen El contenido cambió o se compuso durante la carga. Si engañas a los espectadores, serás castigado con prohibiciones y otras sanciones.

- Usos de Twitter (X) Notas de la comunidad. Este es un algoritmo puente que solo muestra el contexto para lograr el consenso de los usuarios que históricamente han tenido puntos de vista opuestos.

- Cielo azul (protocolo AT) Centrarse en la identidad descentralizada y los algoritmos seleccionables por el usuariopermitiendo que la reputación, la moderación y el etiquetado de contenido de IA sean manejados por servicios independientes en lugar de una agencia de plataforma única.

- Mastodon (Fediverse) se basa en Servidores administrados por la comunidad A través de la gobernanza local, el contenido generado por IA puede limitarse, etiquetarse o excluirse por completo mediante reglas de instancia y federación en lugar de aplicación global.

Está claro que los gigantes tecnológicos están lidiando con problemas de confianza, pero hay un conflicto de la Ley de Jacob. Los usuarios no tendrán una experiencia de usuario única e identificable en la que puedan confiar en todo el ecosistema de información.

¿Y si tuviéramos una etiqueta nutricional de contenido estandarizado?

Recoge una caja de cereal. La parte posterior te dice exactamente lo que hay dentro: 12 gramos de azúcar, 3 gramos de fibra, 150 calorías. El modelo obligatorio de etiquetado nutricional de los alimentos funciona, entonces, ¿por qué no tenemos la misma transparencia para los alimentos consumidos en línea?

1. Marca de estado

Siguiendo el patrón de las etiquetas de los alimentos, los símbolos del frente del paquete deben ser consistentes en X, Instagram y TikTok. ¿Fue capturado/editado/compuesto?

2. Ingredientes

- Procedencia como contexto: muestra la cadena de custodia, no solo basada en el veredicto. Por ejemplo, un registro histórico que refleja el ciclo de vida de un archivo en formato de línea de tiempo.

- Identidad de la fuente: enlace verificado al creador u organización, firmado criptográficamente.

3. Enlaces de triangulación

- Vea publicaciones relacionadas más fácilmente. Por ejemplo, el empujón “Ver publicaciones relacionadas”.

- Enlaces a medios de noticias acreditados o notas de la comunidad que analizan el mismo evento.

Si asumimos que los usuarios necesitan que les digamos la verdad, subestimamos sus habilidades en rápida evolución. Los presentadores de Hard Fork Kevin Roose y Casey Newton han unido fuerzas para crear su propia red socialuniverso tenedor“.

El mejor diseño no soluciona la crisis de autenticidad. Proporcionará a los usuarios herramientas para resolver problemas por sí mismos.

¿La inteligencia artificial nos está entrenando para ser mejores pensadores críticos? Publicado originalmente en Colectivo de experiencia de usuario En Medium, la gente continúa la conversación destacando y respondiendo a esta historia.